Google hat in dieser Woche ein Update durchgeführt, das zu einigen Veränderungen in der Suche führen dürfte. BERT soll dabei helfen, komplexe Suchanfragen zu verstehen. Damit besteht ein inhaltlicher Zusammenhang zum RankBrain-Algorithmus. Laut Google handelt es sich um den größten Sprung nach vorne, den die Suchmaschine in den letzten fünf Jahren vollzogen hat, und einen der größten Sprünge in der Suche überhaupt.

Google hat in dieser Woche ein Update durchgeführt, das zu einigen Veränderungen in der Suche führen dürfte. BERT soll dabei helfen, komplexe Suchanfragen zu verstehen. Damit besteht ein inhaltlicher Zusammenhang zum RankBrain-Algorithmus. Laut Google handelt es sich um den größten Sprung nach vorne, den die Suchmaschine in den letzten fünf Jahren vollzogen hat, und einen der größten Sprünge in der Suche überhaupt.

Wieder gibt es eine spannende Neuigkeit bei Google: Wie das Unternehmen mitteilt, wurde in dieser Woche ein Update durchgeführt, das unter dem Titel BERT steht. Das ist eine Abkürzung für "Bidirectional Encoder Representations from Transformers" und bezeichnet einen Algorithmus, der auf Natural Language Processing (NLP) und neuronalen Netzen basiert. Im vergangenen Jahr hatte Google diese Technik als Open Source zur Verfügung gestellt.

Im Grunde geht es bei BERT darum, Worte in Abhängigkeit von anderen Worten in einem Satz zu verarbeiten, anstatt sie nur Wort für Wort zu betrachten. Somit kann der komplette Kontext von Worten bewertet werden, indem auch die Worte vor und hinter einem anderen Wort beachtet werden. Auf diese Weise lässt sich die Suche-Intention komplexer Suchanfragen besser bestimmen.

Um die Technik nutzen zu können, hat Google laut eigenen Aussagen auch in neue Hardware investiert, die auf Cloud-TPUs (Technical Processing Units oder auch Tensor-Prozessoren) basiert. Damit sollen relevante Ergebnisse schneller geliefert werden.

Google nennt BERT den größten Sprung der Suche in den letzten fünf Jahren und einen der größten Sprünge der Suche überhaupt.

Wie funktioniert BERT?

BERT wirkt sich sowohl auf das Ranking der Suchergebnisse als auch auf die Ausspielung von Featured Snippets aus. Google erklärt, dass BERT dazu beitragen werde, eine von zehn Suchen in englischer Sprache besser zu verstehen. Weitere Sprachen sollen folgen.

Insbesondere komplexe Suchanfragen und solche, bei denen Präpositionen wie "for" und "to" eine Bedeutung für die Suchanfrage haben, können besser verstanden werden. Suchanfragen können zukünftig auf natürliche Weise gestellt werden, das heißt so, wie man einen Menschen fragen würde.

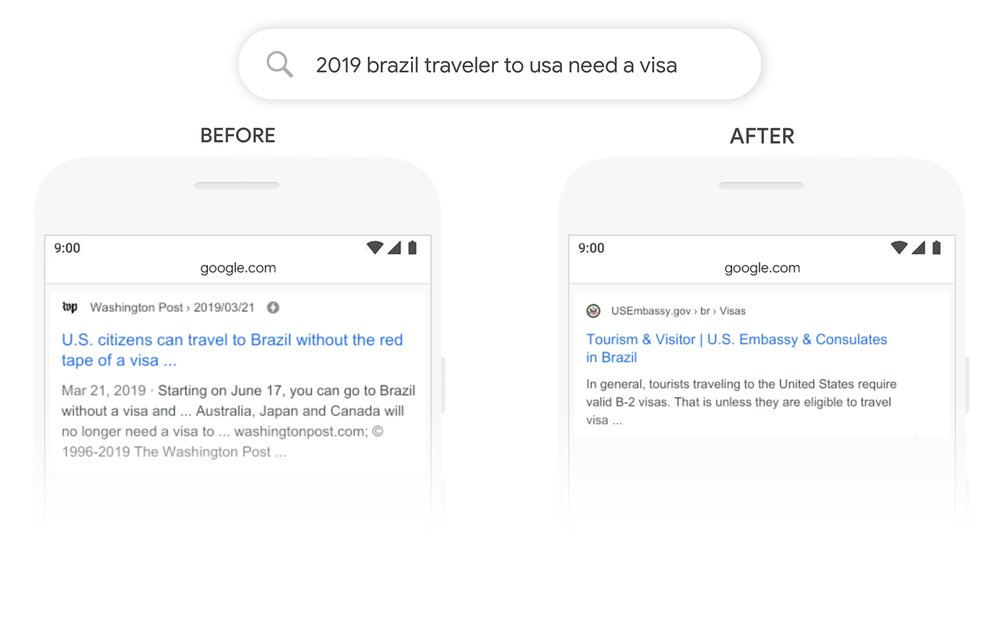

Eines der Beispiele, die Google in diesem Zusammenhang nennt, ist die Suche nach "2019 brazil traveler to usa need visa". Hier ist das Wort "to" von hoher Bedeutung, um den Sinn der gesamten Suchanfrage zu verstehen. Es geht in diesem Fall nämlich um Reisende aus Brasilien in die USA und nicht umgekehrt.

Wie man in der folgenden Abbildung erkennen kann, erfasst Google nach der Umstellung die Bedeutung korrekt, während das Top-Ergebnis vorher die falsche Beziehung abbildete:

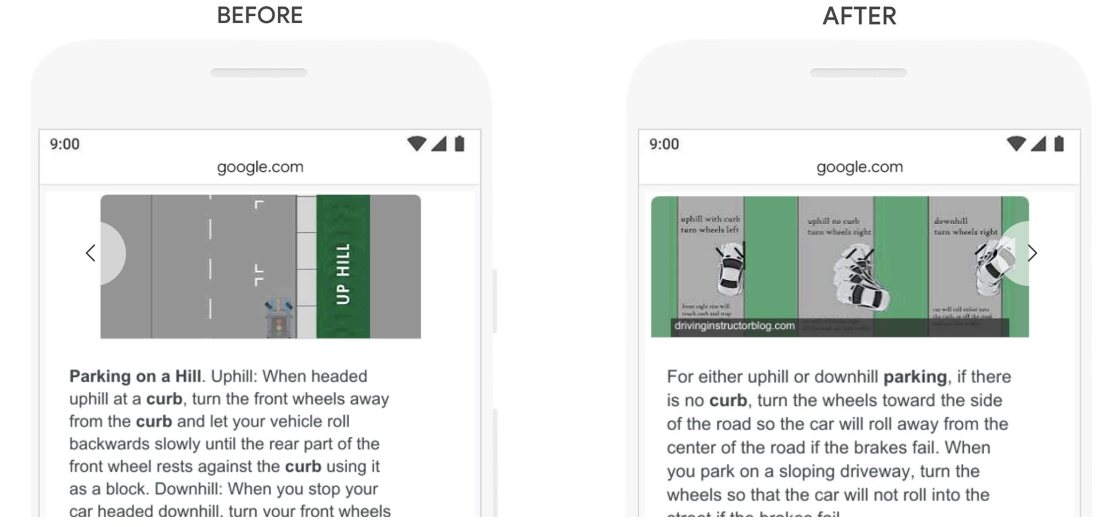

Ein weiteres Beispiel zeigt die Auswirkungen von BERT auf Featured Snippets. Für die Suchanfrage "parking on a hill with no curb" legte Google bisher zu viel Gewicht auf das Wort "curb" (Bordstein). Dafür fiel das "no" unter den Tisch, welches für die Suchanfrage aber entscheidend ist, denn es geht ja gerade um Situationen ohne und nicht mit Bordstein. Das Ergebnis kann man am Vorher-Nachher-Vergleich erkennen:

Wann wird BERT auch für die deutsche Sprache verfügbar sein?

Google nennt noch kein konkretes Datum für die Übertragung von BERT auf weitere Sprachen. Allerdings könne BERT Gelerntes auf andere Sprachen anwenden, so Google. So können Fortschritte in der einen auch Verbesserungen in anderen Sprachen bringen.

BERT werde außerdem genutzt, um Featured Snippets in den 24 Ländern zu verbessern, in denen sie verfügbar sind. Bedeutende Fortschritte habe es zum Beispiel in Koreanisch, Hindi und Portugiesisch gegeben.

Was ist der Unterschied zwischen BERT und RankBrain?

RankBrain wurde von Google im Jahr 2015 eingeführt. Der Algorithmus verwendet maschinelles Lernen, um die Suchanfragen der Nutzer besser zu verstehen. Das ist notwendig, weil noch immer ein großer Anteil aller Suchanfragen, die Google erhält, zum ersten Mal auftauchen. Google beziffert deren Anteil mit 15 Prozent.

Ähnlich wie schon der Jahre zuvor entwickelte Hummingbird-Algorithmus orientiert sich auch RankBrain an der menschlichen Sprache. Gleiches gilt für BERT.

BERT wird RankBrain wohl nicht ersetzen, sondern ergänzen. Die Frage ist, ob es sich um ein Entweder-Oder handelt oder um ein Sowohl-Als-Auch.

Wie steht es mit BERT in Bezug auf SEO? Kann man für BERT optimieren?

Wie auch bei RankBrain gibt es wohl auch für BERT keine konkreten Optimierungsmöglichkeiten, denn es geht hauptsächlich um das Verstehen der Suchanfragen. Allerdings müssen auch die Inhalte aus dem Google-Index entsprechend bewertet werden können, denn sonst würde der Abgleich zwischen Suchanfrage und Ergebnis nicht funktonieren.

Insofern lautet der wichtigste Rat, Inhalte so zu erstellen, dass sie zu den Bedürfnissen und Intentionen der Nutzer passen. Es ist davon auszugehen, dass sich durch BERT eine bessere Verbindung zwischen Suchanfragen und den dazu passenden Ergebnissen einstellen wird.

Sowohl BERT als auch RankBrain orientieren sich an der menschlichen Sprache. Daher ist zu emfpehlen, Texte so zu schreiben, dass sie möglichst natürlich sind, aber auch so, dass sie von den nach wie vor nicht perfekten Algorithmen verstanden werden können. Eine klare Satzstruktur mit nur wenigen Verschachtelungen und recht kurzen Sätzen dürfte hier von Vorteil sein.

Welche Auswirkungen wird BERT auf die Suchergebnisse haben?

Google spricht von etwa zehn Prozent der englischsprachigen Suchanfragen, die von BERT zunächst betroffen sein werden. So ist davon auszugehen, dass die Auswirkungen auf die deutschen Suchergebnisse zumindest in der kommenden Zeit gering sind. Das kann sich aber zukünftig ändern, denn erstens kann BERT das in einer Sprache Gelernte auch auf andere Sprachen anwenden, und zweitens will Google BERT in nächster Zeit auf weitere Sprachen ausweiten.

Waren die in letzter Zeit beobachteten Schwankungen der Suchergebnisse die Folge von BERT?

Wie gestern berichtet gab es wieder stärkere Dynamik auf der Google-SERPs und damit Anzeichen für ein weiteres Google-Update. Ob und inwieweit diese die Folge von BERT waren, kann derzeit noch nicht abgeschätzt werden.

Spannend wird es auf jeden Fall zu beobachten sein, ob es in den nächsten Tagen und Wochen zu nennenswerten Verschiebungen insbesondere in den englischsprachigen Suchergebnissen kommen wird.

Hat BERT Auswirkungen auf Voice Search?

Weil BERT vor allem auf komplexere Suchanfragen abzielt, dürfte der Algorithmus insbesondere für gesprochene Suchanfragen (Voice Search) von Bedeutung sein, denn diese Suchanfragen sind meist komplexer als getippte Suchen. Häufig werden Voice Searches in Form kompletter Sätze gestellt. Das dürfte ein weiterer Grund für Google gewesen sein, BERT zu entwickeln. Der Google Assistant, Googles digitaler Assistent, wird sicherlich von BERT profitieren.