Google berücksichtigt Direktiven aus der robots.txt innerhalb eines Tages

Direktiven aus der robots.txt werden von Google normalerweise innerhalb eines Tages erfasst. Damit lassen sich auch schnelle Änderungen durchführen.

Direktiven aus der robots.txt werden von Google normalerweise innerhalb eines Tages erfasst. Damit lassen sich auch schnelle Änderungen durchführen.

Die robots.txt ist ein wichtiges Element auf einer Webseite, weil darin beschrieben ist, welche URLs, Seiten und Pfade die Crawler der Suchmaschinen erfassen dürfen und welche nicht.

Manchmal sind kurzfristige Änderungen an der robots.txt erforderlich, etwa dann, wenn bestimmte Seiten nicht mehr gecrawlt werden sollen oder wenn es darum geht, bestehende Beschränkungen für die Crawler aufzuheben.

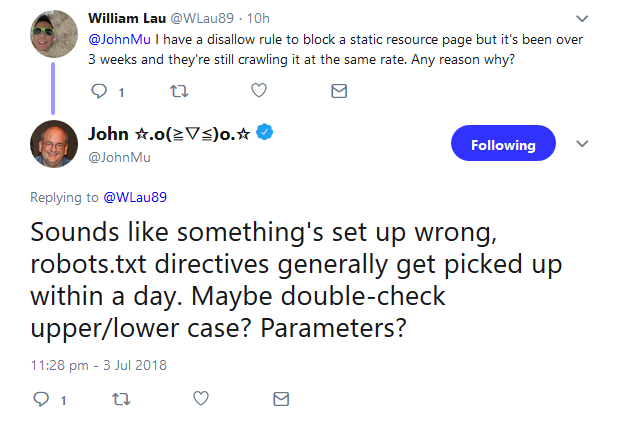

Doch wie lange dauert es, bis Google solche Änderungen an der robots.txt erfasst? Laut Johannes Müller geschieht dies in der Regel innerhalb eines Tages. Das hat er auf Twitter mitgeteilt:

Zuvor hatte ein Nutzer gefragt, warum eine "Disallow"-Regel, die er vor drei Wochen eingerichtet hatte, noch immer nicht greife. Google crawle die betreffende Seite immer noch. Müller gab die Empfehlung, auf Groß- und Kleinschreibung und mögliche Parameter zu achten.

Die kurze Reaktionszeit Googles auf Änderungen in der robots.txt bietet Webmastern eine gewisse Sicherheit, dass auch kurzfristige Anpassungen möglich sind.

Titelbild: Copyright AKS - Fotolia.com

SEO-Newsletter bestellen

Verwandte Beiträge

Google: URLs, die trotz robots.txt indexiert sind, fallen irgendwann aus dem Index