Screaming Frog jetzt mit Logfile-Analyse

Das SEO- und Crawling-Tool Screaming Frog ermöglicht jetzt auch die einfache Analyse von Logfiles. Damit lässt sich beispielsweise untersuchen, welche URLs von den Crawlern der Suchmaschinen abgerufen wurden und ob die Abrufe erfolgreich waren.

Das SEO- und Crawling-Tool Screaming Frog ermöglicht jetzt auch die einfache Analyse von Logfiles. Damit lässt sich beispielsweise untersuchen, welche URLs von den Crawlern der Suchmaschinen abgerufen wurden und ob die Abrufe erfolgreich waren.

Die Analyse von Logfiles gehört zu den Standardaufgaben von SEOs. Bisher waren solche Analysen jedoch meist recht umständlich. Dateien mussten in Excel oder andere Tabellenverwaltungen importiert und dann gefiltert und sortiert werden.

Abhilfe schafft jetzt Screaming Frog, ein von vielen SEO genutztes Werkzeug. Bisher konnte Screaming Frog vor allem crawlen und die Ergebnisse nach Kategorien sortiert darstellen. Neu ist, dass man jetzt auch komplette Logfiles importieren und sich Auswertungen erstellen lassen kann. Der Import der Dateien ist denkbar einfach und funktioniert per Drag&Drop.

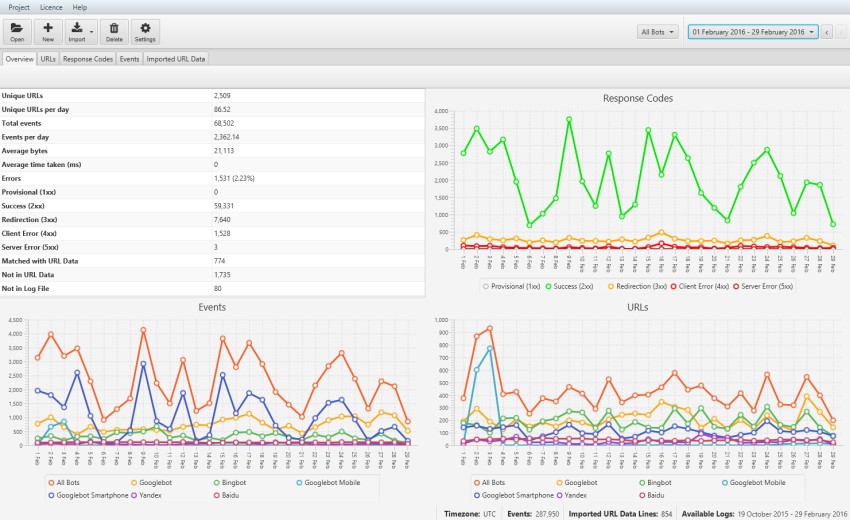

Die Auswertung erlaubt interessante Einblicke in das Verhalten der Suchmaschinen-Crawler. So lässt sich zum Beispiel erkennen, welche Seiten wann und wie oft abgerufen wurden. Man kann nach Fehlern filtern und auf diese Weise feststellen, bei welchen Seiten es beim Abruf zu Problemen kam. Auch die Auswertung nach langen und kurzen URLs dürfte für viele Webseitenbetreiber von Interesse sein.

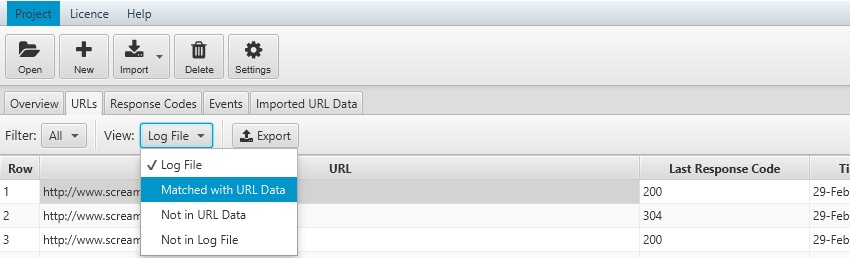

Neben Logfiles können auch Crawl-Daten importiert werden, unter anderem auch aus Screaming Frog, Majestic oder OSE. Per "Not In URL Data"-Filter lassen sich sogenannte Orphan URLs (verwaiste URLs) erkennen, die sich zwar nicht im Crawl befidnen, aber trotzdem in letzter Zeit von den Suchmaschinen besucht wurden. Der Filter "Not in Log File" zeigt solche URLs an, die sich zwar im Crawl befinden, aber nicht mehr von den Suchmaschinen besucht werden.

Mit der kostenlosen Version von Screaming Frog lassen sich bis zu 1.000 Events im Logfile importieren. Die kostenpflichtige Version enthält diese Begrenzung nicht.

Verwandte Beiträge

Google Core Web Vitals mit Screaming Frog abrufen - so funktioniert es