Google warnt vor automatisierten Abfragen an Suchmaschinen

Das automatisierte Abfragen von Suchmaschinen verstößt gegen deren Nutzungsbedingungen. Google hat eine Warnung ausgesprochen und fragt in einem Tweet den Anbieter eines SEO-Tools, ob er die Webmaster-Richtlinien und die Angaben in der robots.txt einhalte.

Das automatisierte Abfragen von Suchmaschinen verstößt gegen deren Nutzungsbedingungen. Google hat eine Warnung ausgesprochen und fragt in einem Tweet den Anbieter eines SEO-Tools, ob er die Webmaster-Richtlinien und die Angaben in der robots.txt einhalte.

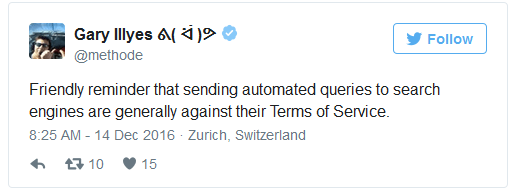

Manche SEO-Tools nutzen automatisierte Abfragen an Google, um beispielsweise aktuelle Rankings zu überprüfen. Das jedoch verstößt gegen Googles Nutzungsbedingungen. Darauf hat Gary Illyes heute in einem Tweet hingewiesen:

Dazu kommt, dass Google in seiner eigenen robots.txt das Crawlen von Suchergebnissen ausgeschlossen hat:

User-agent: *

Disallow: /search

Johannes Müller von Google spricht in einem Tweet direkt den Anbieter eines SEO-Tools an, mit dem man testen kann, welche URLs aus einer Sitemap indexiert sind. Er fragt: "Ist das ein Blackhat-Tool, oder hält es sich an die Webmaster-Richtlinien und die robots.txt (einfach aus Neugier)?"

Anbieter von SEO-Tools, die tatsächlich gegen Googles Willen automatisiert auf die Ergebnisse der Suchmaschine zugreifen, könnten also unsicheren Zeiten entgegen gehen.

Titelbild © giromin - Fotolia.com

Verwandte Beiträge

Google sperrt Workaround für SEO-Tools: Abruf von Suchergebnissen per Search Lite eingeschränkt