Google zeigt neuen Hinweis bei Seiten an, die durch robots.txt blockiert sind

Google hat den Hinweis geändert, der für Seiten angezeigt wird, die per robots.txt blockiert sind.

Google hat den Hinweis geändert, der für Seiten angezeigt wird, die per robots.txt blockiert sind.

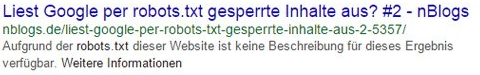

Seiten, die aufgrund von Einstellungen in der robots.txt nicht gecrawlt werden dürfen, können unter Umständen trotzdem in den Suchergebnissen erscheinen. Das ist dann der Fall, wenn eine Seite bereits indexiert wurde und dann nachträglich per robots.tx geblockt wird.

In diesen Fällen hat Google in der Vergangenheit einen Hinweis wie diesen im zugehörigen Snippet angezeigt:

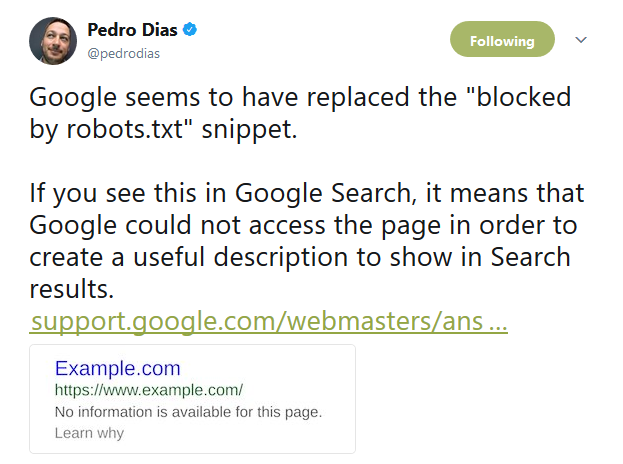

Wie es aussieht, hat Google diesen Hinweis jetzt angepasst. Das hat Pedro Dias entdeckt und per Twitter geteilt:

Dias bezieht sich dabei auf die zugehörige Hilfeseite bei Google. Die robots.txt wird nicht mehr explizit genannt. Stattdessen wird nur noch darauf hingewiesen, dass "keine Informationen für diese Seite verfügbar sind".

Die Meldung verdeutllicht vor allem eines: Die robots.txt ist nicht dazu geeignet, bereits indexierte Seiten aus dem Google-Index zu löschen. Per robots.txt lässt sich nur das Crawlen steuern, aber nicht die Indexierung. Für bereits indexierte Seiten muss ein anderer Weg gewählt werden, möchte man diese aus den Suchergebnissen entfernen: Entweder verwendet man dazu das "noindex"-Attribut in den Meta-Tags, oder man löscht die Seite und sendet beim Aufruf ihrer URL einen 404- oder einen 410-Fehlercode. Damit erkennt Google, dass die Seite nicht mehr besteht.

Titelbild © AKS - Fotolia.com

SEO-Newsletter bestellen

Verwandte Beiträge

Google: URLs, die trotz robots.txt indexiert sind, fallen irgendwann aus dem Index