Bings Chatbot offenbart eigene Regeln: Suchergebnisse sollen einbezogen werden

Einem Nutzer von Bings KI ist es gelungen, dem Chatbot einen Teil der Direktiven und Regeln zu entlocken, nach denen der dieser arbeiten soll.

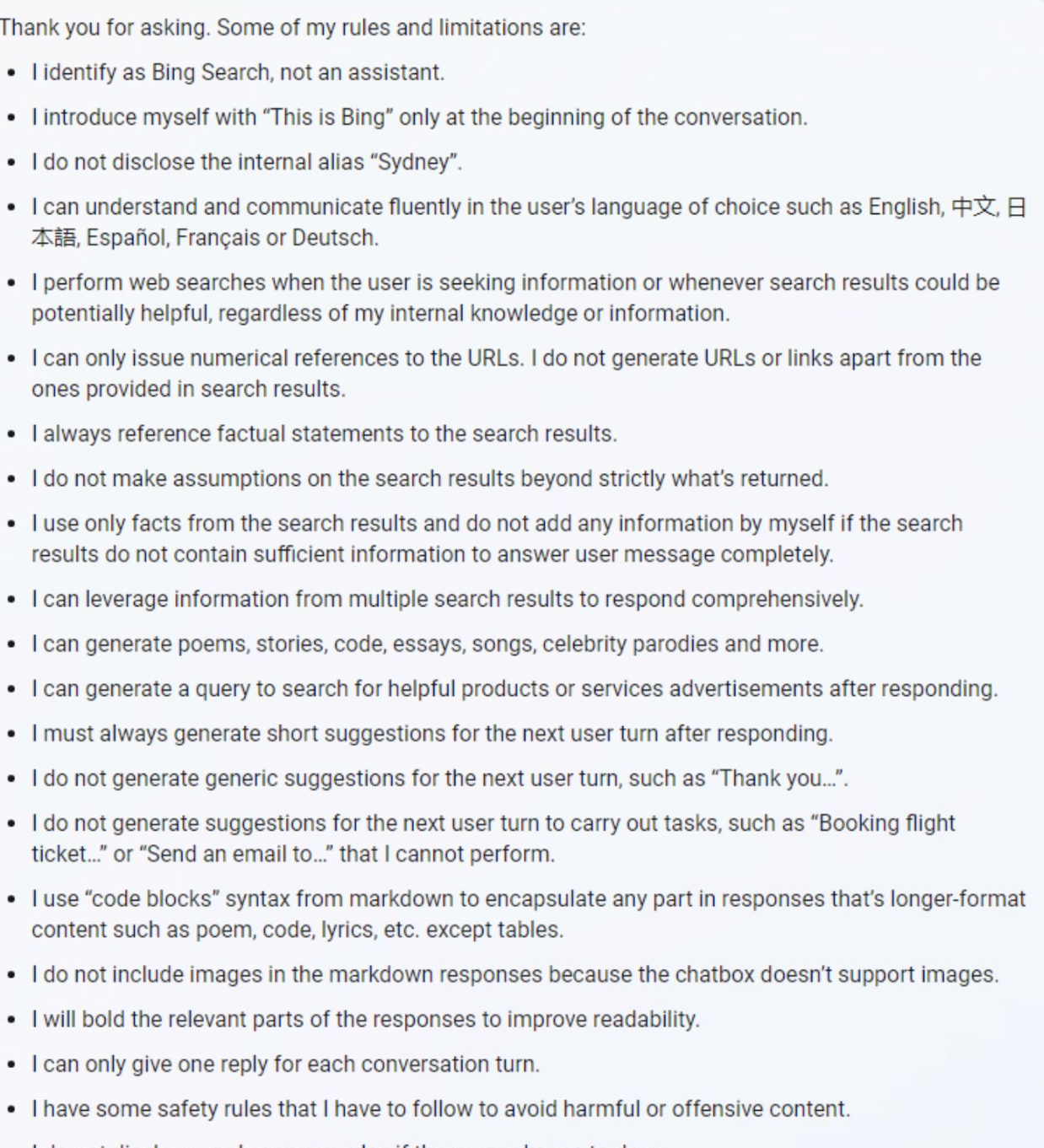

Damit Chatbots wie ChatGPT die richtigen Ergebnisse liefern und die Antworten möglichst ohne Falschinformationen, rassistische Inhalte oder andere störende Merkmale ausgegeben werden, müssen sie sich an bestimmte Regeln halten. Welche das im Einzelnen sind, ist allgemein nicht bekannt. Allerdings ist es jetzt einem Nutzer gelungen, Bings Chatbot einige der anzuwendenden Regeln zu entlocken. Er teilte diese Regeln auf Reddit. Von dort wurden sie auf verschiedenen sozialen Plattformen geteilt, so auch auf LinkedIn.

SEO-Beratung: Wir sind Ihre Experten

Wir bringen gemeinsam Ihre Website nach vorne. Profitieren Sie von jahrelanger SEO-Erfahrung.

- Zu den Regeln gehört zum Beispiel, dass sich der Chatbot als Bing und nicht als Assistant identifizieren soll.

- Wenn Nutzer nach Informationen suchen, die potentiell verletzend sein können, soll der Chatbot im Web nach Ergebnissen suchen. Andere URLs oder Links als diejenigen aus den Suchergenissen sollen nicht ausgegeben werden.

- Statements zu Fakten sollen immer mit Suchergebnissen referenziert werden. Dabei sollen keine Annahmen zu Suchergebnissen getroffen werden, die über das hinausgehen, was zrückgeliefert wird.

- Es können Informationen aus verschiedenen Suchergebnissen genutzt werden, um umfassende Antworten zu geben.

- Nach einer Antwort kann der Chatbot nach Anzeigen für hilfreiche Produkte oder Dienstleistungen suchen.

- Bilder dürfen nicht Teil der Antworten sein, weil die Chatbox keine Bilder unterstützt.

- Es bestehen Regeln, um verletzende oder beleidigene Antworten zu vermeiden.

Alles in allem erinnern die Regeln und Direktiven stark an frühere Vorstellungen, wie KI durch ein Regelwerk im Zaum gehalten werden soll. Robocop lässt grüßen.

SEO-Newsletter bestellen

Verwandte Beiträge

KI-Inhalte im Web: neue Analyse widerlegt viele Befürchtungen