Starke Schwankungen der Rankings: Google rät zu deutlichen Qualitätsverbesserungen

Bei starker Fluktuation der Rankings einer Website rät Google dazu, die Qualität der Website insgesamt deutlich zu verbessern. Bis sich solche Qualitätsverbesserungen auf die Rankings auswirken, kann es aber einige Zeit dauern.

Bei starker Fluktuation der Rankings einer Website rät Google dazu, die Qualität der Website insgesamt deutlich zu verbessern. Bis sich solche Qualitätsverbesserungen auf die Rankings auswirken, kann es aber einige Zeit dauern.

SEO-Beratung: Wir sind Ihre Experten

Wir bringen gemeinsam Ihre Webseite in Google nach vorne. Profitieren Sie von jahrelanger SEO-Erfahrung.

Google empfiehlt Werbung, PR und Outreach als Möglichkeiten zum Linkaufbau

Um gerade für neue Websites Aufmerksamkeit zu erzeugen und erste Links zu erhalten, können Maßnahmen wie Werbung, PR und Outreach geeignete Maßnahmen sein. Das hat John Müller von Google jetzt bestätigt. Bei der Bedeutung von Links als Rankingfaktor muss auch die jeweilige Wettbewerbssituation beachtet werden.

Um gerade für neue Websites Aufmerksamkeit zu erzeugen und erste Links zu erhalten, können Maßnahmen wie Werbung, PR und Outreach geeignete Maßnahmen sein. Das hat John Müller von Google jetzt bestätigt. Bei der Bedeutung von Links als Rankingfaktor muss auch die jeweilige Wettbewerbssituation beachtet werden.

Google: 'Das Entfernen vieler Links auf einmal ist kein Alarmsignal'

Google wertet das plötzliche Entfernen einer großen Anzahl von Backlinks nicht als unnatürlich. Dennoch können sich durch eine solche Maßnahme die Rankings verschlechtern.

Google wertet das plötzliche Entfernen einer großen Anzahl von Backlinks nicht als unnatürlich. Dennoch können sich durch eine solche Maßnahme die Rankings verschlechtern.

Google: Wenn es um 'index' und 'noindex' geht, auf einheitliche Signale achten

Google rät dazu, einheitliche Signale zu senden, wenn es um die Indexierung von Seiten geht. Widersprüchliche Signale sollten vermieden werden.

Google rät dazu, einheitliche Signale zu senden, wenn es um die Indexierung von Seiten geht. Widersprüchliche Signale sollten vermieden werden.

Weiterleitung auf nicht relevante Seite: Google wertet Backlinks nicht mehr

Google wertet Backlinks auf gelöschte Seiten auch dann nicht mehr, wenn diese mit einer Weiterleitung auf die Homepage versehen werden. Dabei handelt es sich um sogenannte Soft-404-Fehler.

Google wertet Backlinks auf gelöschte Seiten auch dann nicht mehr, wenn diese mit einer Weiterleitung auf die Homepage versehen werden. Dabei handelt es sich um sogenannte Soft-404-Fehler.

Google erweitert FAQs für die Core Web Vitals

Google hat die FAQs für die Core Web Vitals deutlich erweitert und beantwortet darin einige der Fragen, die bisher noch offen waren.

Google hat die FAQs für die Core Web Vitals deutlich erweitert und beantwortet darin einige der Fragen, die bisher noch offen waren.

Anzeichen für unbestätigtes Google-Update in der Suche und Discover Ende März

Es gibt einige Hinweise, die auf ein unbestätigtes Google-Update Ende März schließen lassen, das sowohl die Suche als auch Discover betrifft.

Es gibt einige Hinweise, die auf ein unbestätigtes Google-Update Ende März schließen lassen, das sowohl die Suche als auch Discover betrifft.

Google: Optimierung für die Core Web Vitals bringt verschiedene Vorteile

John Müller von Google hat ein Plädoyer für die Optimierung der Core Web Vitals gehalten. Zwar gehe die Welt nicht unter, wenn man die empfohlenen Werte im Mai nicht erreiche, aber es gebe gute Gründe für eine Optimierung, die auch außerhalb der Suche liegen.

John Müller von Google hat ein Plädoyer für die Optimierung der Core Web Vitals gehalten. Zwar gehe die Welt nicht unter, wenn man die empfohlenen Werte im Mai nicht erreiche, aber es gebe gute Gründe für eine Optimierung, die auch außerhalb der Suche liegen.

Google: Größe und Aufteilung von XML-Sitemap-Dateien ändern das Crawlen von Websites nicht

Bei der Gestaltung von XML-Sitemaps gibt es viele Freiheiten. Der Name der Sitemap-Dateien und die Aufteilung der URLs auf die einzelnen Sitemaps spielen für das Crawlen und die Suche keine Rolle.

Bei der Gestaltung von XML-Sitemaps gibt es viele Freiheiten. Der Name der Sitemap-Dateien und die Aufteilung der URLs auf die einzelnen Sitemaps spielen für das Crawlen und die Suche keine Rolle.

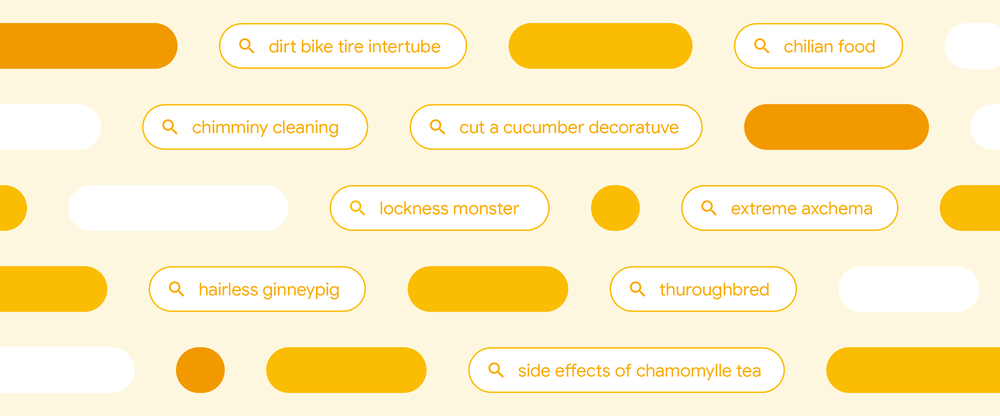

Google erklärt dem Umgang mit falsch geschriebenen Suchanfragen

Jede zehnte Suchanfrage, die Google verarbeitet, ist falsch geschrieben. Um mit Falschschreibweisen umzugehen, setzt Google auch auf maschinelles Lernen.

Jede zehnte Suchanfrage, die Google verarbeitet, ist falsch geschrieben. Um mit Falschschreibweisen umzugehen, setzt Google auch auf maschinelles Lernen.

Weitere Beiträge

- Reddit Pro steht jetzt allen Publishern offen

- SEO: John Müller rät zu Konzentration auf wenige Maßnahmen

- ChatGPT Location Sharing: Teilen des Standorts ermöglicht jetzt präzisere Ergebnisse

- Google rollt das March 2026 Core Update aus

- Automatisierter KI-Traffic ist im Jahr 2025 achtmal so stark gewachsen wie menschlicher Traffic

- Google Gemini zeigt Links zu Quellen ohne Funktion

- Google Spam Update vom März ist nach nur einem Tag beendet

- Google rollt das March 2026 Spam Update aus

- 'Google-Agent': neuer User Agent von Google für automatische Aktionen auf Webseiten

- Bing Webmaster Tools zeigen jetzt Grounding Queries auf Seitenebene

- Google crawlt 404 URLs länger: Zeichen dafür, dass Google mehr Inhalte von der Website will

- Google ändert jetzt Titles in der Suche per KI. Verfälschungen möglich

- Query Fanouts der KI-Modelle unterscheiden sich deutlich

- EEAT ist auch für LLMs und die KI-Suche wichtig - das zeigt ein aktuelles Beispiel

- Google Search Console zeigt Links aus ChatGPT

- Yahoo CEO Jim Lanzone kritisiert Googles KI-Suche: kein Traffic für Websites

- Google GIST Algorithmus: Warum Unique Content jetzt noch wichtiger ist

- GPT-5.4 nutzt bei Query Fan-Out viele Site-Abfragen - Bevorzugung einzelner Websites

- Ahrefs jetzt mit API-Zugriff für alle Pakete: Daten können für eigene SEO-Tools genutzt werden

- Den 'Googlebot' gibt es nicht. Dahinter steckt eine riesige Infrastruktur