Google crawlt auch solche Websites regelmäßig, die lange auf 'noindex' standen

Auch wenn eine Website lange komplett auf 'noindex' gesetzt war, crawlt Google Teile davon im Abstand von wenigen Tagen. Davon können auch diejenigen profitieren, die ihre Website aus Versehen auf 'noindex' gesetzt haben.

Auch wenn eine Website lange komplett auf 'noindex' gesetzt war, crawlt Google Teile davon im Abstand von wenigen Tagen. Davon können auch diejenigen profitieren, die ihre Website aus Versehen auf 'noindex' gesetzt haben.

SEO-Beratung: Wir sind Ihre Experten

Wir bringen gemeinsam Ihre Webseite in Google nach vorne. Profitieren Sie von jahrelanger SEO-Erfahrung.

Google Search Console: Neuer Leistungsbericht für Google News

In der Google Search Console gibt es einen neuen Leistungsbericht für Websites, die in Google News gelistet sind. Damit erhalten die Betreiber betroffener Websites weitere wertvolle Informationen zur Performance ihrer Inhalte.

In der Google Search Console gibt es einen neuen Leistungsbericht für Websites, die in Google News gelistet sind. Damit erhalten die Betreiber betroffener Websites weitere wertvolle Informationen zur Performance ihrer Inhalte.

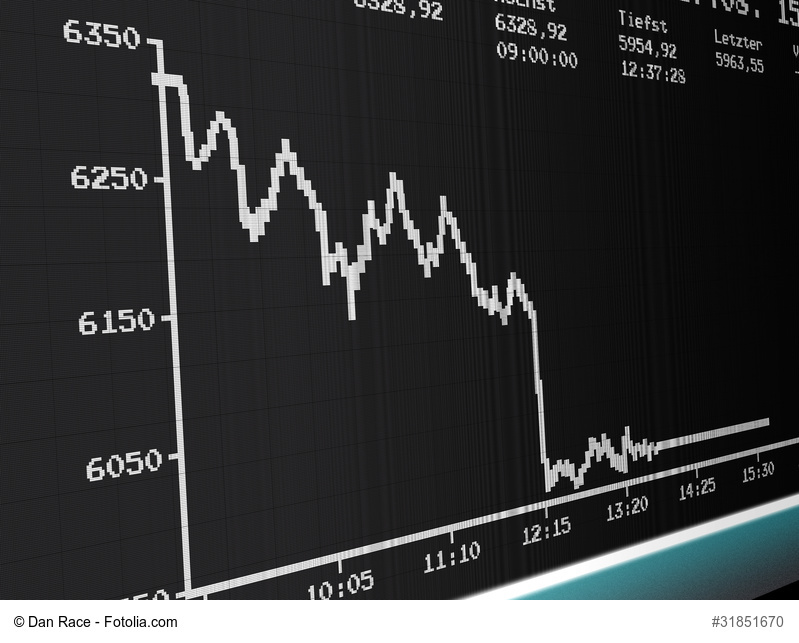

Google: Fokussierung auf einen einzelnen Aspekt kann das Gesamtbild verschlechtern

Es ist selten eine gute Idee, sich bei der SEO auf einen einzelnen Aspekt zu konzentrieren, denn dadurch kann sich laut Google das Gesamtbild verschlechtern.

Es ist selten eine gute Idee, sich bei der SEO auf einen einzelnen Aspekt zu konzentrieren, denn dadurch kann sich laut Google das Gesamtbild verschlechtern.

Google: Manuelle Maßnahmen werden nicht wegen einzelner Links verhängt

Google verhängt manuelle Maßnahmen gegen Websites nicht aufgrund weniger Links, sondern wegen genereller Muster. Das gilt auch für das Aufheben solcher Maßnahmen: Werden einzelne Links beim Aufräumen übersehen, stellt das laut Google normalerweise kein Problem dar.

Google verhängt manuelle Maßnahmen gegen Websites nicht aufgrund weniger Links, sondern wegen genereller Muster. Das gilt auch für das Aufheben solcher Maßnahmen: Werden einzelne Links beim Aufräumen übersehen, stellt das laut Google normalerweise kein Problem dar.

Google bringt deutliche Verbesserungen für den Index Coverage Report der Search Console

Google hat einige Verbesserungen für den Report zur Indexabdeckung in der Search Console vorgestellt. Neben der Abschaffung der Kategorie 'Crawling-Anomalie' gibt es eine neue Art von Warnung sowie einen genaueren Bericht zu Soft-404-Fehlern.

Google hat einige Verbesserungen für den Report zur Indexabdeckung in der Search Console vorgestellt. Neben der Abschaffung der Kategorie 'Crawling-Anomalie' gibt es eine neue Art von Warnung sowie einen genaueren Bericht zu Soft-404-Fehlern.

Google Search Console: Kategorie 'Crawling-Anomalie' wird jetzt durch spezifischere Kategorien ersetzt

Google ersetzt in der Search Console die Kategorie 'Crawling-Anomalie' durch spezifischere Kategorien. Das hatte John Müller bereits vor kurzer Zeit angekündigt.

Google ersetzt in der Search Console die Kategorie 'Crawling-Anomalie' durch spezifischere Kategorien. Das hatte John Müller bereits vor kurzer Zeit angekündigt.

Google: Link-Tracking erfolgt auf Basis der Canonicals bei Quell- und Zielseite

Google trackt Backlinks auf Basis der Canonical-URLs von der verlinkenden und der verlinkten Seite. Das ist auch im Hinblick auf die Daten in der Google Search Console wichtig, denn dadurch kann es bei einer Website-Migration länger dauern, bis alle Links im Link-Report übertragen sind.

Google trackt Backlinks auf Basis der Canonical-URLs von der verlinkenden und der verlinkten Seite. Das ist auch im Hinblick auf die Daten in der Google Search Console wichtig, denn dadurch kann es bei einer Website-Migration länger dauern, bis alle Links im Link-Report übertragen sind.

Google ist beim Indexieren neuer, großer Websites zunächst vorsichtig

Bevor Google eine neue Website zu großen Teilen indexiert, dauert es meist eine Weile. Das liegt daran, dass Google gerade bei großen Websites mit vielen URLs zunächst nur einen Teil der Inhalte crawlt und dann auf Signale wartet.

Bevor Google eine neue Website zu großen Teilen indexiert, dauert es meist eine Weile. Das liegt daran, dass Google gerade bei großen Websites mit vielen URLs zunächst nur einen Teil der Inhalte crawlt und dann auf Signale wartet.

Subtopics sind live: Google kann jetzt Unterthemen für Suchergebnisse besser abdecken

Google hat eine Anpassung zum besseren Erkennen von Unterthemen für Suchanfragen live genommen. Das kann zu einer größeren Vielfalt auf den Suchergebnisseiten führen.

Google hat eine Anpassung zum besseren Erkennen von Unterthemen für Suchanfragen live genommen. Das kann zu einer größeren Vielfalt auf den Suchergebnisseiten führen.

Google: SMITH-Algorithmus übertrifft BERT bei längeren Texten

SMITH ist ein neuer Algorithmus, der Google beim Verstehen längerer Texte helfen könnte. Damit übertrifft er BERT, dessen Fokus sich auf einzelne Sätze beschränkt.

SMITH ist ein neuer Algorithmus, der Google beim Verstehen längerer Texte helfen könnte. Damit übertrifft er BERT, dessen Fokus sich auf einzelne Sätze beschränkt.

Weitere Beiträge

- Reddit Pro steht jetzt allen Publishern offen

- SEO: John Müller rät zu Konzentration auf wenige Maßnahmen

- ChatGPT Location Sharing: Teilen des Standorts ermöglicht jetzt präzisere Ergebnisse

- Google rollt das March 2026 Core Update aus

- Automatisierter KI-Traffic ist im Jahr 2025 achtmal so stark gewachsen wie menschlicher Traffic

- Google Gemini zeigt Links zu Quellen ohne Funktion

- Google Spam Update vom März ist nach nur einem Tag beendet

- Google rollt das March 2026 Spam Update aus

- 'Google-Agent': neuer User Agent von Google für automatische Aktionen auf Webseiten

- Bing Webmaster Tools zeigen jetzt Grounding Queries auf Seitenebene

- Google crawlt 404 URLs länger: Zeichen dafür, dass Google mehr Inhalte von der Website will

- Google ändert jetzt Titles in der Suche per KI. Verfälschungen möglich

- Query Fanouts der KI-Modelle unterscheiden sich deutlich

- EEAT ist auch für LLMs und die KI-Suche wichtig - das zeigt ein aktuelles Beispiel

- Google Search Console zeigt Links aus ChatGPT

- Yahoo CEO Jim Lanzone kritisiert Googles KI-Suche: kein Traffic für Websites

- Google GIST Algorithmus: Warum Unique Content jetzt noch wichtiger ist

- GPT-5.4 nutzt bei Query Fan-Out viele Site-Abfragen - Bevorzugung einzelner Websites

- Ahrefs jetzt mit API-Zugriff für alle Pakete: Daten können für eigene SEO-Tools genutzt werden

- Den 'Googlebot' gibt es nicht. Dahinter steckt eine riesige Infrastruktur