Crawl-delay in robots.txt kann Googlebot unter Umständen komplett blockieren

Das Verwenden von 'Crawl-delay' in der robots.txt kann in bestimmten Fällen dazu führen, dass Google die komplette Website nicht mehr crawlen kann.

SEO-Beratung: Wir sind Ihre Experten

Wir bringen gemeinsam Ihre Webseite in Google nach vorne. Profitieren Sie von jahrelanger SEO-Erfahrung.

Google Core Update vom Mai: Rollout ist abgeschlossen

Google hat den Abschluss des 'May 2022 Core Updates' bestätigt. Damit dauerte das Update etwas mehr als zwei Wochen.

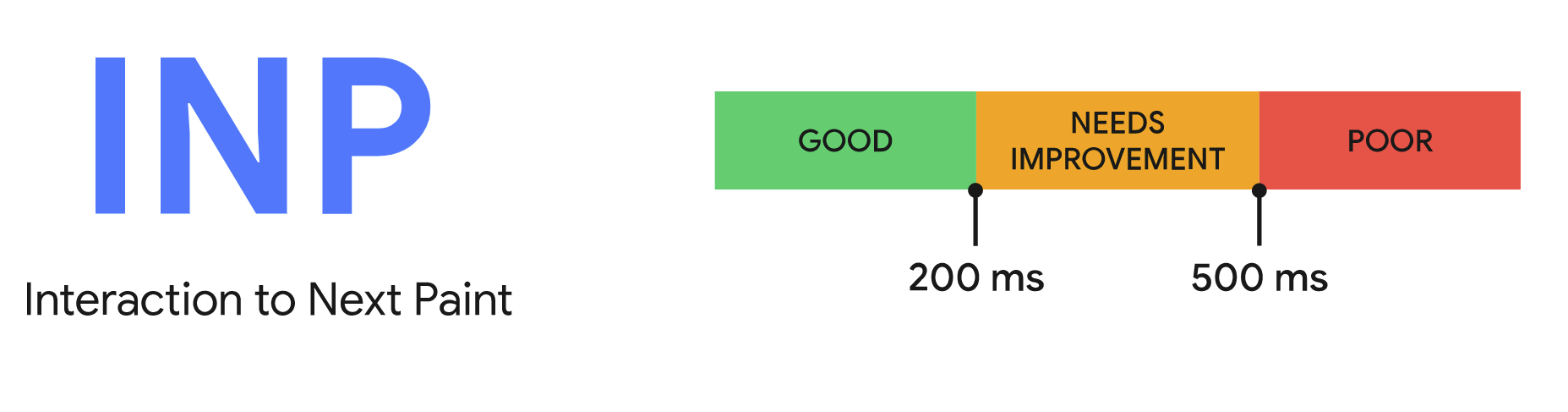

Google PageSpeed Insights zeigt jetzt auch die Interaction to Next Paint

Google PageSpeed Insights zeigt jetzt auch den Wert für die Interaction to Next Paint an. Das ist eine neue Kennzahl, die bald zu den Core Web Vitals gehören könnte.

Google: Umgang mit Links auf Seiten mit 'noindex, follow' ist nicht definiert

Wie Google Links auf Seite behandelt, die mit 'noindex, follow' gekennzeichnet sind, lässt sich nicht vorhersagen. Daher ist es wichtig, klare Signale zu setzen.

Google: Zufällige Links von Websites, die man nicht kennt, sind nicht toxisch

Wegen zufälliger Links, die man von anderen Websites erhält, muss man sich laut John Müller von Google keine Sorgen machen. Der Begriff 'toxische Links' stammt laut Müller ohnehin nur von den Anbietern bestimmter SEO-Tools.

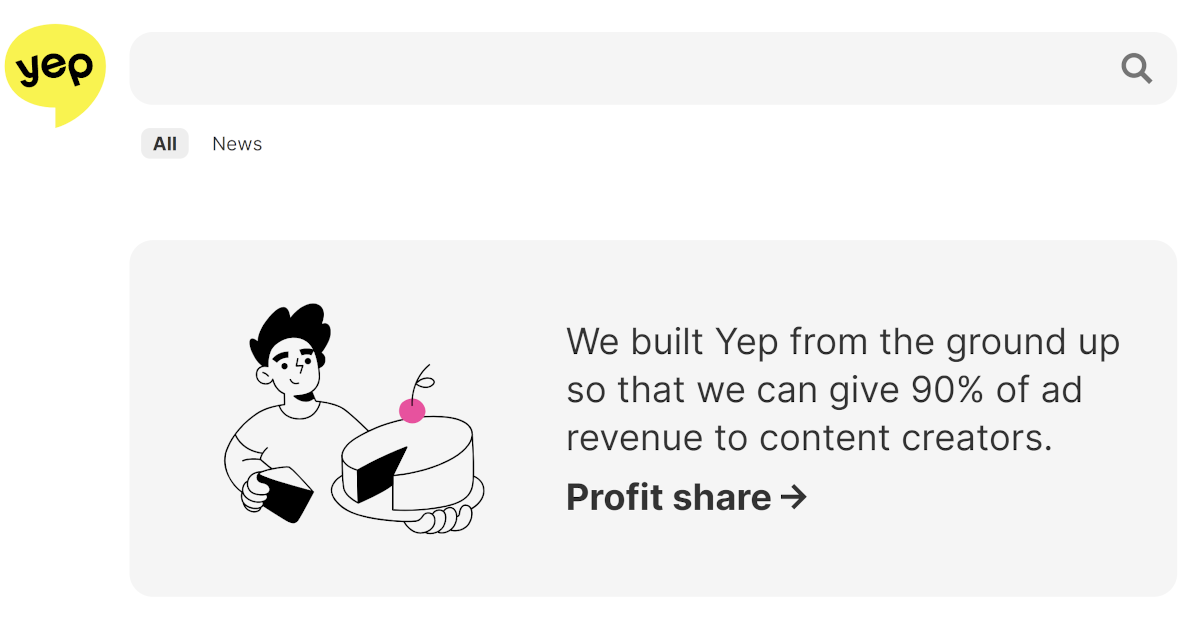

Yep: Ahrefs bringt eigene Suchmaschine auf den Markt

Ahrefs, Anbieter eines bekannten SEO-Tools, bringt eine eigene Suchmaschine auf den Markt. Der Name: Yep.

Google ändert die Auswahl von Titeln mehrsprachiger Seiten

Google hat eine algorithmische Änderung vorgenommen, welche die Auswahl des Titels mehrsprachiger Seiten betrifft. Auch Seiten mit Titeln, die aus nicht lateinischen Buchstaben in lateinische Schrift überführt wurden, sind von dem Update betroffen.

Google: Verlinken auf zitierte Quellen ohne 'nofollow' ist gute SEO-Praxis

Laut Google sollte man auf Quellen, die man zum Erstellen von Beiträgen verwendet, ohne 'nofollow' verlinken. Gute SEO orientiere sich am Handeln guter Menschen.

Google kann mit fehlerhaften Redirects zur Homepage umgehen

Google versteht, wenn URLs nicht mehr vorhandener Seiten anstatt eines 404-Fehlers auf die Homepage einer Website weitergeleitet werden.

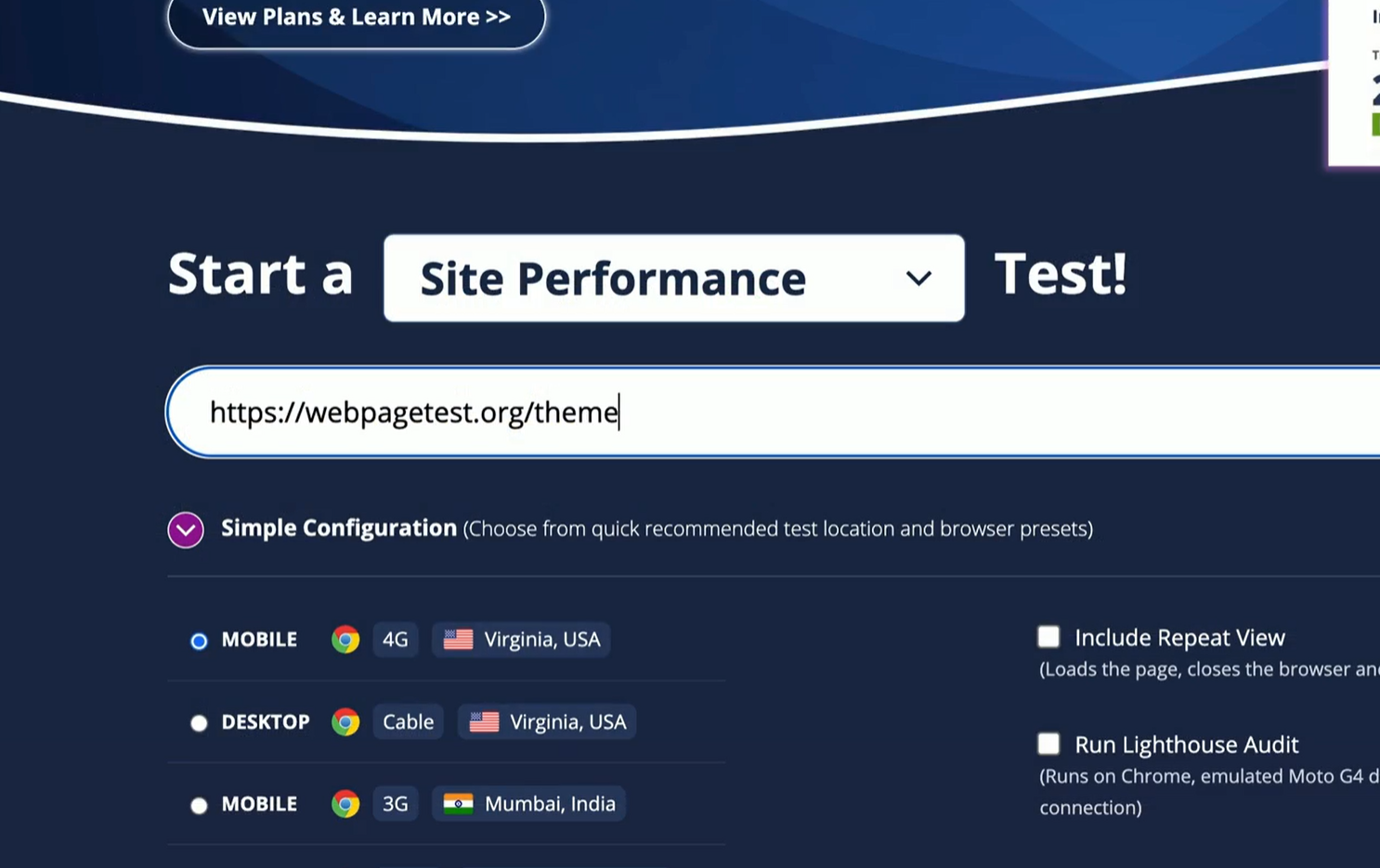

WebPageTest bietet jetzt Empfehlungen und Experimente ohne Codeänderungen

Mit WebPageTest lassen sich jetzt Experimente für mehr Performance ohne Änderungen auf den zu ändernden Seiten durchführen.

Weitere Beiträge

- Google rollt das March 2026 Core Update aus

- Automatisierter KI-Traffic ist im Jahr 2025 achtmal so stark gewachsen wie menschlicher Traffic

- Google Gemini zeigt Links zu Quellen ohne Funktion

- Google Spam Update vom März ist nach nur einem Tag beendet

- Google rollt das March 2026 Spam Update aus

- 'Google-Agent': neuer User Agent von Google für automatische Aktionen auf Webseiten

- Bing Webmaster Tools zeigen jetzt Grounding Queries auf Seitenebene

- Google crawlt 404 URLs länger: Zeichen dafür, dass Google mehr Inhalte von der Website will

- Google ändert jetzt Titles in der Suche per KI. Verfälschungen möglich

- Query Fanouts der KI-Modelle unterscheiden sich deutlich

- EEAT ist auch für LLMs und die KI-Suche wichtig - das zeigt ein aktuelles Beispiel

- Google Search Console zeigt Links aus ChatGPT

- Yahoo CEO Jim Lanzone kritisiert Googles KI-Suche: kein Traffic für Websites

- Google GIST Algorithmus: Warum Unique Content jetzt noch wichtiger ist

- GPT-5.4 nutzt bei Query Fan-Out viele Site-Abfragen - Bevorzugung einzelner Websites

- Ahrefs jetzt mit API-Zugriff für alle Pakete: Daten können für eigene SEO-Tools genutzt werden

- Den 'Googlebot' gibt es nicht. Dahinter steckt eine riesige Infrastruktur

- ChatGPT zitiert gelöschte Wikipedia-Artikel und bietet damit Einfallstor für Spam

- Digg entlässt große Teile des Entwickler-Teams: KI-Probleme unterschätzt

- Google ist die meist zitierte Quelle im Google AI Mode - in 19 von 20 Branchen